Anthropic的IPO豪赌:在最不该说不的时刻,它偏偏说了不

想象这样一个场景。

你欠了三个月的水电费,你上个月去医院看了病,你每年老老实实报税。这些事情之间,似乎没有任何关联。

但在某一套 AI 系统里,这三条信息被汇总在一起,在地图上生成了一个红点。那个红点,代表的是你的位置,和一个针对你的执法指令。

这不是科幻小说。2026 年初,美国联邦移民局在明尼阿波利斯展开大规模围捕行动,背后用的就是这套逻辑。相关 AI 系统来自一家叫 Palantir 的数据公司,它把移民的医疗记录、水电账单、纳税信息整合进算法,冷酷地标记出一个个追捕目标。

AI 正在被武器化。不是将来时,是现在进行时。

问题已经不是它会不会发生,而是谁有权利决定它能做什么、不能做什么。

2026 年 2 月 27 日,这个问题得到了一个令人不安的答案。

那一天,一家叫 Anthropic 的 AI 公司——也就是对话 AI 产品 Claude 的开发者,和 ChatGPT 同一个量级的竞争对手,被美国政府正式封禁。封禁的原因是,它拒绝让自己的 AI 被用于监控美国公民,以及自主决定击杀目标。

它因为说「不能这么用」,被列为了「国家安全风险」。

一家准备 IPO 的公司,最需要什么

在回答「Anthropic 为什么不妥协」之前,先要理解它现在处于什么位置。

Anthropic 是目前全球估值最高的 AI 公司之一,估值 3800 亿美元,2025 年全年营收达到 140 亿美元。它最大的金主是亚马逊,持股比例超过任何其他股东。它的 AI 模型 Claude,是目前企业市场采购量增长最快的 AI 产品之一。

按照任何标准来看,这都是一家准备好上市的公司。而事实上,Anthropic 今年确实在筹备 IPO,也就是首次公开上市,让普通人也能买到它的股票。

一家准备上市的公司,最需要什么?答案几乎不需要思考:稳定、可预期、没有监管麻烦。任何负面事件,都可能影响投资者对公司的信心,进而压低 IPO 的定价。

然后,事情朝着完全相反的方向发展了。

2025 年 7 月,五角大楼同时向 Anthropic、OpenAI(ChatGPT 的开发者)、Google 和马斯克的 xAI 各签署了一份最高 2 亿美元的合同,目标是把最先进的 AI 接入美国军事系统。这是 AI 历史上规模最大的一次政府采购。

值得注意的是,Anthropic 的合同里有一个细节,其他三家公司都没有。它白纸黑字地写进了两条使用限制:Claude 不能被用于大规模监控美国公民,也不能被用于没有人类介入的自主武器系统。

OpenAI、Google、xAI,全部同意军方可以将 AI 用于所有合法目的,没有任何附加限制。只有 Anthropic,在合同里画了两条红线。

这两条红线,后来成了一切麻烦的起点。

最后通牒

2026 年 2 月,五角大楼决定向 Anthropic 施压。

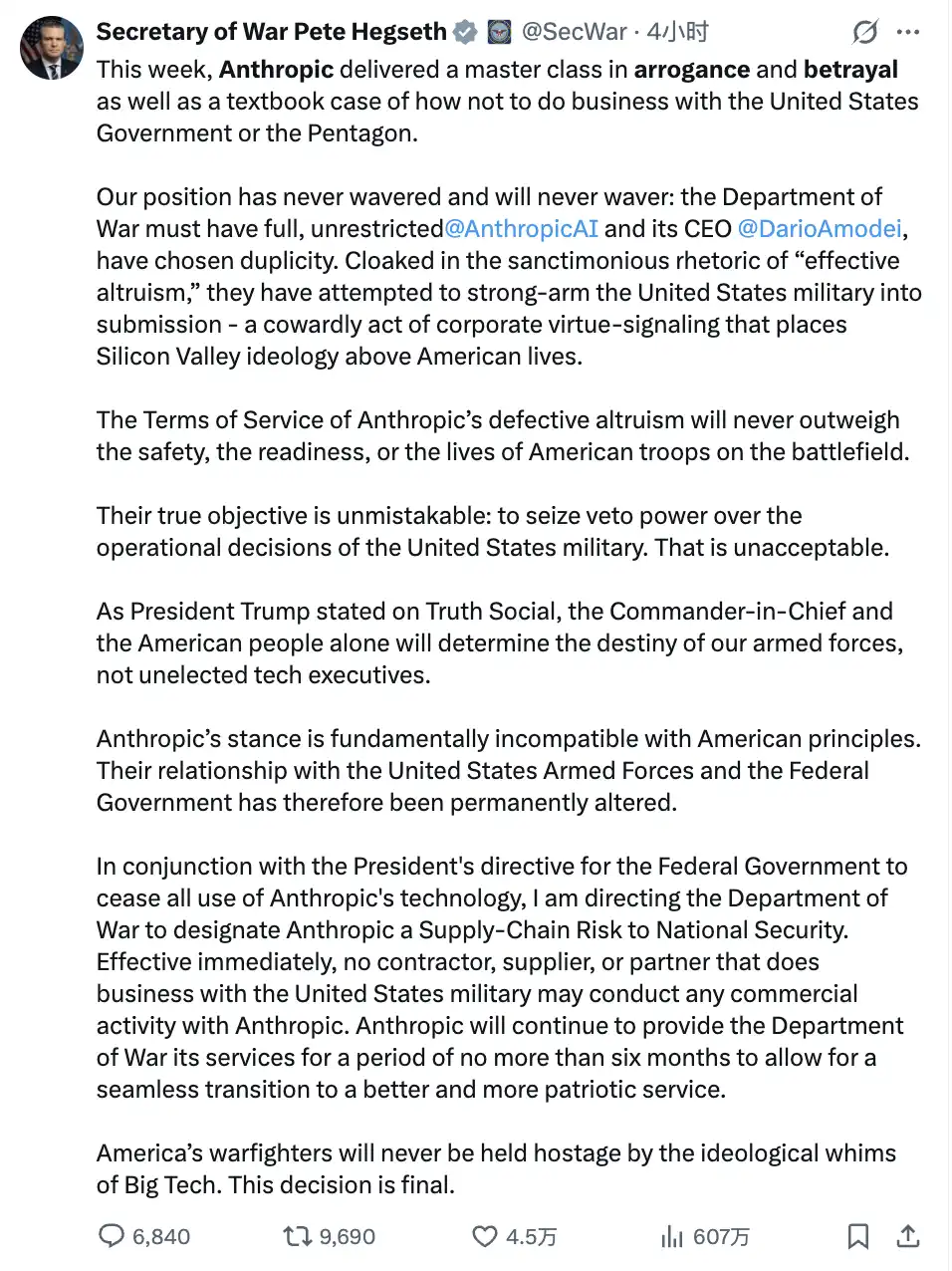

国防部长 Pete Hegseth 给 Anthropic 的 CEO Dario Amodei 发出最后通牒:移除合同里的使用限制,允许 Claude 被用于所有合法目的。否则,五角大楼将取消合同,并将 Anthropic 列为「供应链风险」。期限是当地时间 2 月 27 日下午。

Dario 的回应是:不行。

他在公开声明里写道:「我们理解,军事决策由政府而非私人企业来做。但在极少数情况下,我们相信 AI 可能会破坏而非捍卫民主价值观。我们问心无愧,无法接受他们的要求。」

五角大楼的科技负责人 Emil Michael 随即在社交媒体上发文,称 Dario 是骗子,「有上帝情结」,「试图个人控制美国军队,不惜让国家安全承担风险」。

然后是特朗普亲自下场。他在自己的社交平台 Truth Social 上写道,Anthropic 是「激进左派觉醒公司」,「犯了一个灾难性的错误」,并下令:联邦政府所有机构,立即停用 Anthropic 的全部产品,6 个月内完成过渡。

五角大楼随即将 Anthropic 列为「供应链风险」。

这个标签,在此之前只用来标记与中国等外国对手有关联的企业。给华为用过,中芯国际用过。现在轮到了一家总部在旧金山、估值 3800 亿美元的美国 AI 公司。

2 亿美元是小事,真正的麻烦在这里

很多人的第一反应是:失去 2 亿美元的政府合同,对于年营收 140 亿的 Anthropic 来说,不过是零头。

这个判断是对的,但看错了地方。

真正的杀伤力来自「供应链风险」这个标签本身。它的意思是:任何与美国军方有合作关系的企业,都必须证明自己的业务里没有碰过 Anthropic。这不是软性的道德压力,是硬性的合规要求。

顺着这条线往下拉,影响范围开始变得不那么乐观。

亚马逊云服务是 Claude 的主要运行基础设施,同时也是美国政府最大的云服务提供商,两者之间存在深度绑定。数据分析公司 Palantir,在为美国军方和情报机构提供服务时整合了 Claude。国防科技公司 Anduril,在五角大楼相关项目里用 Claude 处理数据。

这些客户现在必须做出选择:继续用 Claude,承担与一家「供应链风险」公司合作的压力;还是换掉 Claude,替换掉已经深度嵌入工作流程的工具。

两个选项对 Anthropic 来说都是损失。这才是真正需要管理的风险,远比那 2 亿美元的合同金额更值得担心。

而所有这些麻烦,都发生在 IPO 之前。

为什么还是拒绝了

问题变得有意思了。

一家正在冲刺 IPO、偏偏在这个节骨眼上最不需要麻烦的公司,面对政府的压力选择了硬刚。这到底是一个商业判断的失误,还是一个被算清楚的赌注?

把两个选项并排放在一起,逻辑会更清晰。

如果妥协,合同保住,政府关系维持,眼前的麻烦消失。但 Anthropic 过去三年最核心的品牌叙事——「最负责任的 AI 公司」、「安全第一」,会在这一刻出现裂缝。

更大的风险不在眼前。一旦 Claude 真的被用于大规模监控或自主武器决策,一旦发生任何事故,损失的就不是一份合同,而是整个公司的估值逻辑。投资者当初为「Responsible AI」这个故事支付的溢价,会在一夜之间蒸发。

如果拒绝,丢掉 2 亿美元,触发供应链风险标签,政府市场基本关闭。但「安全第一」的品牌叙事,得到了有史以来最昂贵的一次公开背书。没有任何公关预算能买到这个效果,被政府封禁,原因是拒绝让 AI 监控本国公民。

Dario 在声明里说了一句话,值得单独拿出来看:「我们的估值和营收,在这次立场之后只增不减。」

这句话是公关说辞,还是商业判断?可能两者都是,但它们并不矛盾。

这里有一个反面案例可以参考。Palantir 就是前面提到那家用 AI 帮联邦移民局追踪目标的数据公司——走了完全相反的路。它深度配合政府的每一个需求,对移民追踪、情报分析、军事目标锁定来者不拒。因此,它在讲究社会责任的主流资本圈被放逐了将近二十年,长期融不到钱,被大型基金拒之门外。

然后在 2024 年,当 AI 军工叙事成为市场的主流故事,它的股价一年涨了 150%,市值突破 4000 亿美元。

两种路径,两种命运,都有各自的逻辑。Palantir 用二十年的忍耐换来了今天的爆发。Anthropic 押注的是另一套估值逻辑——在 AI 公司同质化竞争日趋激烈的今天,「最安全的 AI」不只是道德立场,是真实存在的商业护城河。

哪个赌注更大,现在还不知道。但 Anthropic 显然认为,妥协的代价比拒绝更高。

Dario 的赌注,能赢吗

这道题的答案,取决于几个还没有落地的变量。

首先,是企业客户的真实反应。亚马逊、Palantir 和 Anduril,会因为「供应链风险」的标签主动切割 Claude,还是选择按兵不动,等待局势变化?目前,这些公司都还没有做出公开表态。如果它们选择观望,Anthropic 的实际损失就真的只有那 2 亿美元的政府合同。

其次,是政府替换的实际难度。五角大楼内部使用 Claude 的部门自己也承认:Claude 目前是性能最强的可用 AI 模型之一,马斯克的 Grok 在技术水平上与它仍有差距。替换,意味着降级使用。这个成本,由谁来承担?

最后,是这件事出人意料的连锁效应。就在 Anthropic 被封禁的同一天,ChatGPT 的开发者 OpenAI 的 CEO Sam Altman,公开站出来表了态:OpenAI 和 Anthropic「共享同样的红线」,对于军事 AI 的使用边界,两家公司的立场是一致的。

换句话说——如果政府想找一个愿意完全服从、没有任何限制的替代方案,可选项比想象中少得多。

AI 武器化的进程,不会因为这件事放慢。马斯克的 Grok 已经进了五角大楼的机密网络,其他 AI 公司的军事合同一份没少,AI 辅助的武器系统还在继续迭代。

Anthropic 的选择,改变不了这个方向。改变的,只是它自己在这个方向上站在哪里。

但有一件事是确定的:这是 AI 行业有史以来,第一次有一家主流公司以明确的原则为由,公开顶住了政府的压力——哪怕最终付出了被封禁的代价。无论这场赌注输赢如何,这个先例已经存在。

最后一道算术题,留给读者:一家估值 3800 亿的公司,为了两条写在合同里的原则,放弃了整个政府市场,然后被列为国家安全风险。

在 AI 加速武器化的今天,这笔账怎么算——取决于你认为,未来最贵的东西是什么。

欢迎加入律动 BlockBeats 官方社群:

Telegram 订阅群:https://t.me/theblockbeats

Telegram 交流群:https://t.me/BlockBeats_App

Twitter 官方账号:https://twitter.com/BlockBeatsAsia

技术被武器化已是既成事实。Palantir的案例清晰地展示,数据整合与AI分析如何成为精准监控与执法工具,这印证了加密社区长期以来的担忧——数据滥用并非理论风险,而是正在发生的现实。当技术能力超越监管框架时,企业的伦理选择就成为关键防线。

Anthropic在IPO前关键节点拒绝政府要求,表面看是巨大商业风险,实则是对其核心资产——“可信AI”品牌——的战略保护。在AI模型能力逐渐同质化的竞争中,安全与责任将成为稀缺的差异化要素。其CEO的声明暗示,他们判断坚守原则带来的品牌价值提升,长远看将超过失去政府合约的短期损失。这种计算类似于加密项目选择抗审查特性可能牺牲短期用户增长,但换取长期社区信任。

“供应链风险”标签的实质是合规隔离,这类似于加密领域某些技术被列为国家安全威胁后,金融机构与科技公司被迫与之切割的情况。这种行政标签具有网络效应,会引发连锁反应,但其实际杀伤力取决于盟友的站队。OpenAI的表态表明,行业内部对红线存在共识,这为Anthropic提供了缓冲空间。

最终,这揭示了技术巨头的两难:配合政府可能获得短期利益但丧失道德立场(如Palantir路径),坚持原则可能面临行政打压但构建长期信任。Anthropic的选择本质上是用短期政府市场换取全球企业市场对其“安全AI”定位的认可。在AI监管尚未成形的阶段,这种立场博弈将定义未来行业的权力边界。

融资信息

融资信息

专题

专题

链上生态

链上生态

词条

词条

播客

播客

活动

活动

0

0